GPU Solution:

GPU に最適化されたソフトウェアでディープラーニング、機械学習、HPC のワークフローをシンプルに。

この NGC カタログは、NVIDIA 社が公開をしている NGC コンテナレジストリおよび GPU に最適化された各種コンテナの Docker イメージを提供するサービスです。AI、ハイパフォーマンス コンピューティング (HPC)、データ分析ソフトウェアのハブであり、エンドツーエンドのワークフローをシンプルにし高速化します。

エンタープライズグレードのコンテナ、学習済み AI モデル、業界固有の SDK をクラウド、オンプレミス問わずに配備できるためクラス最高のソリューションを構築し、今までより短期間で事業価値を創出できます。

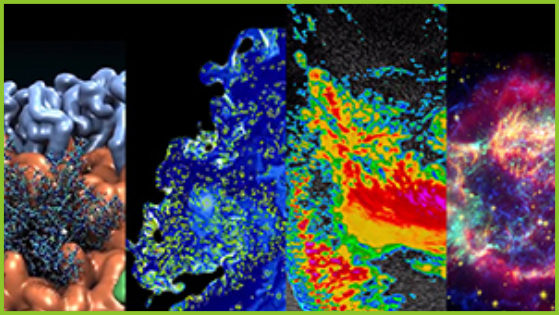

▶ ディープラーニングと HPC のためのコンテナ

豊富な GPU 対応コンテナ

|

NVIDIA が最適化したディープラーニング ソフトウェア、サードパーティが管理する HPC アプリケーション、NVIDIA の HPC ビジュアライゼーション ツール、パートナーのアプリケーションなど、GPU 対応コンテナの包括的なカタログをご利用いただけます。

|

数週間ではなく、数分でイノベーション

|

短時間で立ち上げ、運用。ソフトウェアの面倒な設定も少なくすみます。 HPCテックでは NVIDIA NGC カタログを直ぐにご利用頂けるようセットアップ済みでお届けしています。 |

|

常に最新の状態

|

NVIDIA ディープラーニング コンテナは毎月更新され、最高のシステム パフォーマンスが維持されます。サードパーティ コンテナでは、現行のソフトウェア リリースに簡単にアクセスできます。 |

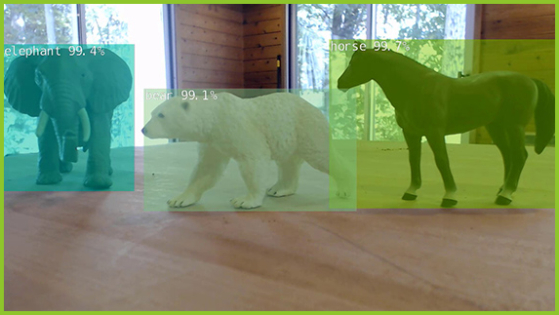

▶ あらゆる用途のためのプラットフォーム<例>

▶ すべてのフレームワークと統合

ディープラーニングフレームワークは、高水準プログラミングインターフェイスを介してディープニューラルネットワークの設計やトレーニング、検証をするためのビルディングブロックを提供します。Caffe2、Cognitive toolkit、MXNet、PyTorch、TensorFlow などの広く使用されているディープラーニングフレームワークは、cuDNN や TensorRT などの GPU アクセラレーションライブラリに依存して高性能の GPU アクセラレーショントレーニングと推論を提供します。

最新の GPU 最適化を備え、CUDA ライブラリおよびドライバーと統合されたコンテナ化されたフレームワークを NGC カタログで見つけることができます。コンテナ化されたフレームワークは、毎月のリリースの一部として検証およびテストされ最高のパフォーマンスを提供します。

ユーザー ガイド: NVIDIA コンテナおよびディープラーニング フレームワーク

|

|

コンテナレジストリから各種ディープラーニングソフトウェアのコンテナイメージを取得し NVIDIA Docker で実行する方法を、豊富なコマンド例で詳細に解説。

第1章 Docker コンテナー |

NVIDIA NGC 簡易マニュアル

|

ディープラーニング用 GPU ワークステーション および GPU ラックマウントサーバをご購入のお客様に HPCテック編集の NVIDIA NGC マニュアルをお付けしています。

|

|

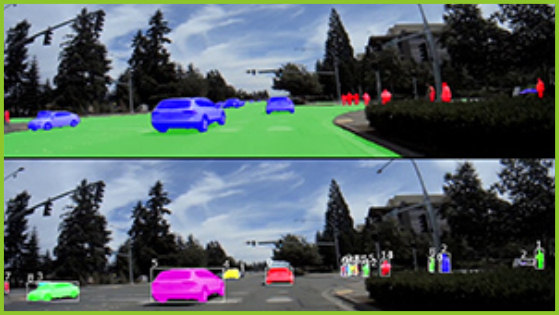

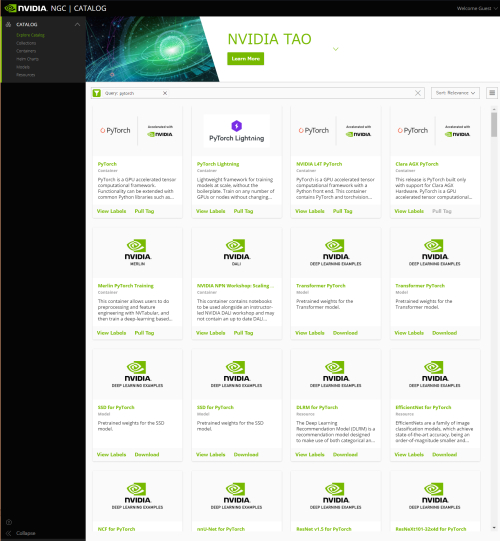

▶ NVIDIA TAO で AI アプリケーションを短期間で開発

NVIDIA TAO は、NGC カタログの事前トレーニング済みモデル、TAO Toolkit、連合学習、NVIDIA TensorRT などの主要な NVIDIA テクノロジーを統合することで、AI 利用への障壁を低くします。このプラットフォームは、さまざまなレベルの AI 専門知識を持つユーザのニーズを満たすために、新しい UI ベースのガイド付きワークフローを通じて AI アプリケーションの作成を簡素化します。さらに、NVIDIA Fleet Command の統合により、IT マネージャーは最適化された AI アプリケーションを展開および調整できます。

NVIDIA TAO は、NGC カタログの事前トレーニング済みモデル、TAO Toolkit、連合学習、NVIDIA TensorRT などの主要な NVIDIA テクノロジーを統合することで、AI 利用への障壁を低くします。このプラットフォームは、さまざまなレベルの AI 専門知識を持つユーザのニーズを満たすために、新しい UI ベースのガイド付きワークフローを通じて AI アプリケーションの作成を簡素化します。さらに、NVIDIA Fleet Command の統合により、IT マネージャーは最適化された AI アプリケーションを展開および調整できます。

NVIDIA TAO、Metropolis、Fleet Command を使用して、AI を複雑な産業環境に適応させます。

▶ NVIDIA NGC カタログにアクセス

製品案内

- NVIDIA Tensor Core GPU

- NVIDIA H100 NEW

- A800 40GB Active NEW

- NVIDIA A10

- NVIDIA A30

- NVIDIA A100

- NVIDIA V100s

- NVIDIA T4

- NVIDIA V100

- NVIDIA Quadro SERIES

- RTX 4500 Ada NEW

- RTX 4000 Ada NEW

- L40S NEW

- RTX 5000 Ada NEW

- RTX 4000 SFF Ada NEW

- RTX 6000 Ada NEW

- NVIDIA L40

- NVIDIA RTX A5500

- NVIDIA RTX A4500

- NVIDIA A40

- NVIDIA RTX A6000

- NVIDIA RTX A5000

- NVIDIA RTX A4000

- Quadro RTX8000 Passive

- Quadro RTX8000

- Quadro RTX6000

- Quadro GV100

- Quadro GP100

- Quadro P6000

- NVIDIA TITAN SERIES

- NVIDIA TITAN RTX

- NVIDIA TITAN V

- NVIDIA TITAN Xp

- NVIDIA TITAN Xp-SW

- NVIDIA GeForce SERIES

- GeForce RTX3090

- GeForce RTX2080Ti

- GeForce GTX1080Ti

- GeForce GTX1080

- GPUワークステーション

- HPCT WRSE31-4GP

- HPCT WR17as-4GP

- HPCT WR13as-4GP

- HPCT W117gs

- HPCT W116gs

- HPCT W216gs

- HPCT WR16gs

- HPCT WRSX42-4GP NEW

- HPCT WRSX31-4GP

- HPCT WRSX32-4GP

- HPCT WR26gs-Silent

- HPCT WR26gs

- GPUラックマウントサーバ

- HPCT RS2E41-4GP NEW

- HPCT RG2E42-4GPNEW

- HPCT RG2E31-4GP

- HPCT R217gg-4GP

- HPCT RG2E32-8GP

- HPCT R227gg-8GP

- HPCT RS4E42-8GP NEW

- HPCT RS4E32-8GP

- HPCT R427as-8GP

- HPCT R116gs

- HPCT RS1X32-4GP

- HPCT R126gs

- HPCT R126gs-4GP

- HPCT RS2X41-2GP NEW

- HPCT RS2X42-4GP NEW

- HPCT RS2X32-6GP

- HPCT R226gs

- HPCT R426gs-8GP

- HPCT RS4X42-8GP NEW

- HPCT RS4X32-10GP

- HPCT R426gs-10GP

- GPUラックマウントサーバ

- for NVLink - NVIDIA DGX H100 NEW

- NVIDIA DGX A100

- HPCT RS2E32-4GN

- HPCT R227as-4GN

- HPCT RS4X42-4GN NEW

- HPCT RS2X32-4GN

- HPCT R126gs-4GN

- HPCT RS4E32-8GN

- HPCT R427as-8GN

- HPCT RS4X32-8GN

- HPCT R426gs-8GN

- HPCT RX26gs-16GN

- 販売終息製品

- サービス

- セットアップサービス

- DL クラスタ管理

- ベンチマーク情報

- NVIDIA GPU CLOUD

- GPUアプリケーション

- 化学・量子化学

- AMBER

- GROMACS

- NAMD

- 量子化学

- GAMESS-UK

- GAMESS-US

- 物質科学

- VASP

- 数値解析

- MATLABS

- Mathematica

- 数値流体力学

- Ansys Fluent

- 構造力学

- Abaqus

- Ansys Mechanical

- LS-DYNA

- MSC Nastran

- MSC Marc

- 電磁界

- CST Microwave

Studio(MWS) - JMAG

- タンパク質構造解析

- AlphaFold

- RELION

- GPUユーザレポート

- GPU TEST DRIVE CENTER

- GPUテストドライブとは

- HPCT-Trial

- 導入事例

- 会社情報

- サポート

- お取引・お問い合わせ